对 Human in the Loop 的新理解

Human in the Loop 的终局,不是人永远在 Loop 里。

*

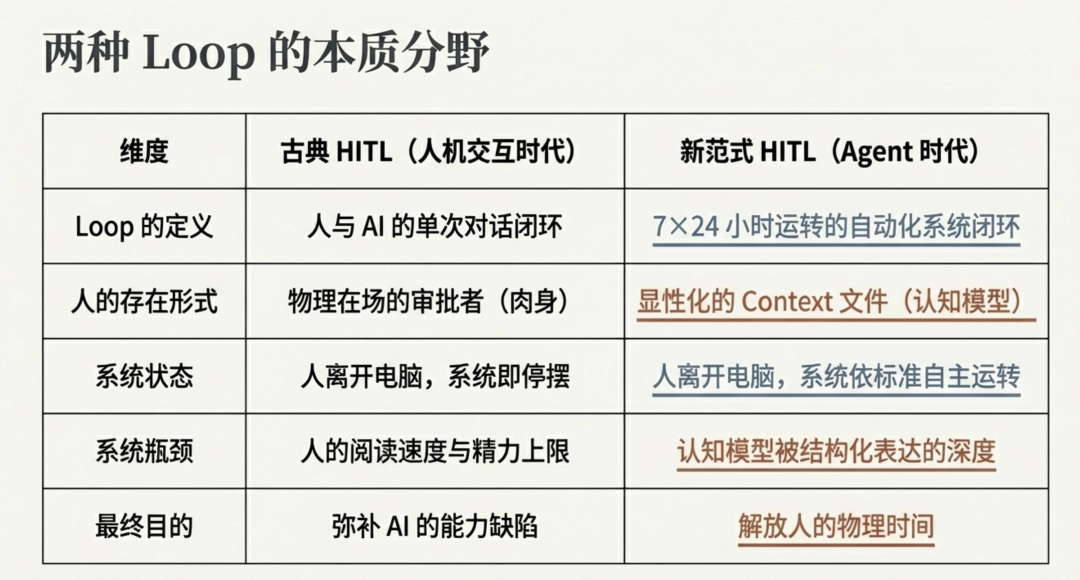

最近我一直在想一个问题:我们谈了这么多年的 Human in the Loop,到底在说什么?

这个词在 HCI 领域太常见了,几乎成了一种默认正确的设计原则——AI 系统必须让人参与决策,人必须保持在回路中。从交互式机器学习到 LLM Agent,所有人都在说 Human in the Loop。

但我最近构建自己的 Agent 系统时,产生了一个很不一样的想法。

*

"In the Loop"到底是什么意思

我们先把这个词拆开看。

Loop 是什么?在控制论的语境下,Loop 是一个闭合的反馈回路——输入、处理、输出、反馈、再输入。它是持续运转的。

Human in the Loop,字面意思就是: 把人放进这个持续运转的系统里。

过去几十年,这个设计思路是对的。因为 AI 的能力有限,很多决策它做不好,需要人来兜底。人在 Loop 里,是作为系统的纠错机制存在的。

但现在情况变了。

当 AI 系统从单次交互变成持续运转的 Agent,Loop 不再是一个偶尔转一圈的东西——它是 7×24 小时不停的。这时候"人在 Loop 里"意味着什么?

意味着系统每转一圈,都需要你在场。

AI 生成了一个方案,你审批。AI 写了一段内容,你确认。AI 做了一个决策,你签字。系统跑得越快,你的审批队列越长。

你名义上是监督者,实际上变成了 系统的瓶颈 。

这是一个 HCI 领域很少被正面讨论的问题:Human in the Loop 作为一种设计范式,它隐含的假设是—— 人的注意力和在场时间是无限的。

但显然不是。

*

第一个新思考:In the Loop 的"Loop"是整个 AI 系统

我发现很多人对 Human in the Loop 的理解是浅层的。

他们以为 Loop 是"我和 AI 之间的一次对话"——我输入、AI 输出、我反馈、AI 修改。这是交互层面的 Loop,但不是系统层面的 Loop。

当我们说 Agent 时代的 Human in the Loop,这个 Loop 是 整个 AI 系统 。

以我自己的 AgentOS 为例。我有情报系统每天自动从多个来源抓取信息、做趋势推演;有内容系统自动调用历史素材、生成初稿、执行审核流程;有目标管理系统追踪进度、做复盘。这些系统是持续运转的,不是我发起一次对话才启动。

在这个语境下,"Human in the Loop"不是说你在和某个 AI 聊天。而是说: 你这个人,被嵌入了一个持续运转的自动化系统中,作为其中一个节点存在。

理解这一点很重要。因为一旦你意识到自己是系统的一个节点,你就会问一个关键问题:

这个节点必须是我真人吗?

*

第二个新思考:如果你一直在 Loop 里,你永远在电脑前

这是一个很朴素但容易被忽略的推论。

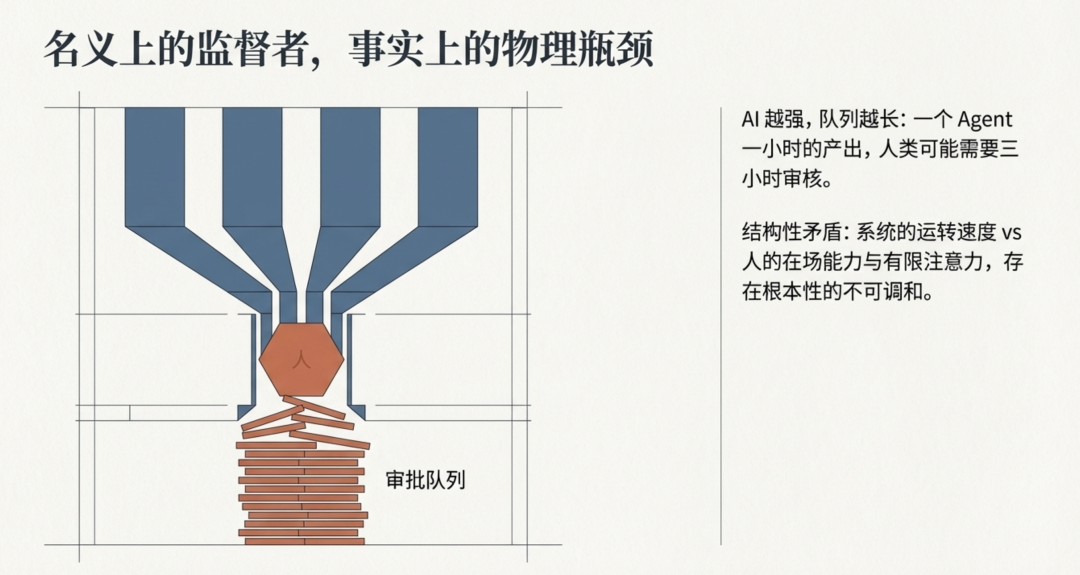

如果 Loop 是 7×24 持续运转的,而你真人必须在 Loop 里,那你就得 7×24 在电脑前。这显然不可能,所以实际情况是——系统在等你。

每次你离开电脑,系统就卡住了。你去吃饭,审批队列在积累。你去睡觉,决策在排队。你回来之后,要处理的不是当下的问题,而是过去几小时积压的问题。

AI 越强大、越自动化,这个问题越严重。 因为 AI 产出的速度远超人类审批的速度。一个 Agent 一小时能产出的东西,你可能要花三小时审核。

这不是技术问题,这是人机交互的结构性矛盾: 系统的运转速度和人的在场能力之间,存在根本性的不匹配。

传统 HCI 研究处理这个问题的方式,通常是优化界面——让审批更快、让信息呈现更高效、减少认知负荷。这些都有价值,但它们解决的是"人在 Loop 里时如何更高效",而不是"人是否应该一直在 Loop 里"。

我认为,后者才是更本质的问题。

用 AgentOS 构建你的竞争力(一人公司/副业)#Mixlab AgentOS 知识+能力体系进阶训练营N26

*

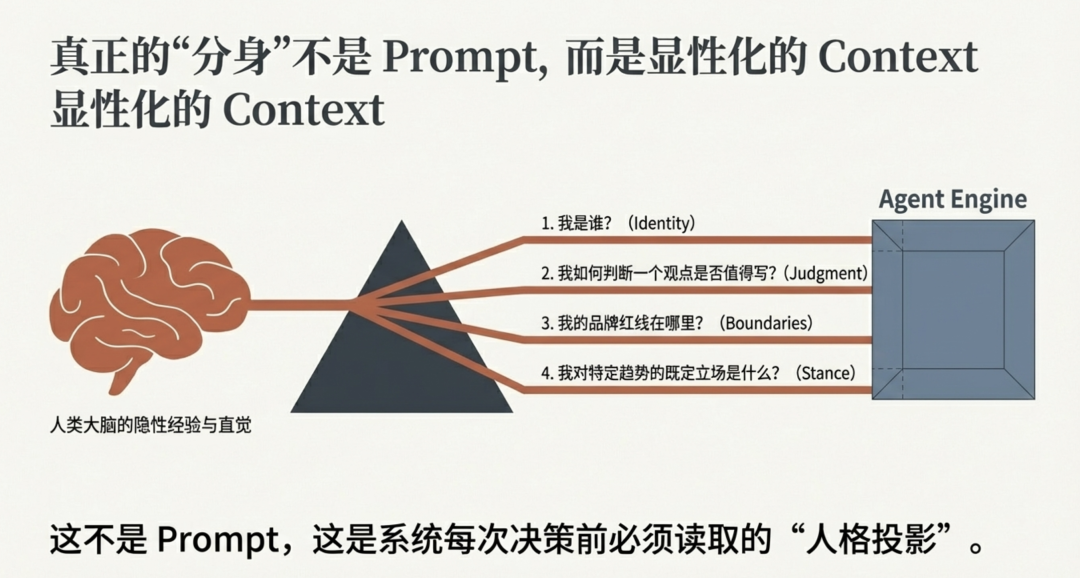

第三个新思考:构建你的分身进入 Loop,你才能抽离

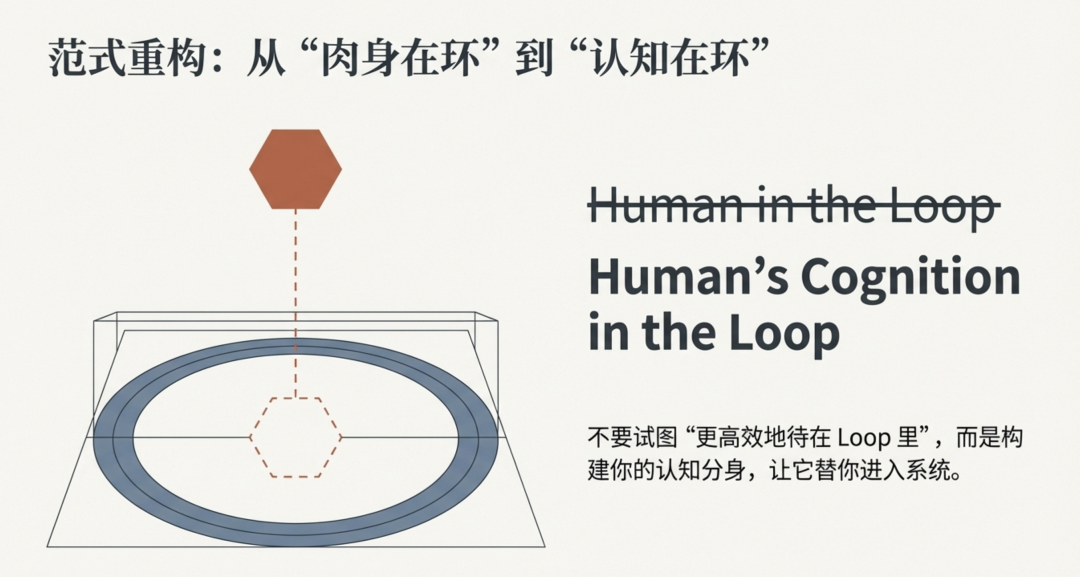

这是我最近想通的一件事,也是对 Human in the Loop 最大的重新理解:

如果你不想永远在电脑前,你不应该试图"更高效地待在 Loop 里"。你应该构建一个你的分身,让它替你进入 Loop。

分身是什么?不是科幻概念。它是你的判断标准、决策逻辑、专业经验、价值观边界——被显性化、结构化,变成 AI 系统可以读取和执行的东西。

在我的实践中,这些东西被写成一组 Context 文件。它们定义了:我是谁、我怎么判断一个观点是否值得写、我的品牌红线是什么、我对某个趋势的立场是什么。系统里的每一个 Agent 在做决策之前,都会先读取这些文件。

它们不是 prompt,是"我"的投影。

当这个投影足够精确时,系统的大部分决策就不需要我真人在场了。Agent 可以基于我的标准做判断,只有少数超出边界的情况才会推到我面前。

这意味着什么?意味着 Loop 里依然有 "Human"——只不过不是我的肉身,而是我的认知模型。

Human in the Loop 变成了 Human's Cognition in the Loop。

这可能是一个值得认真讨论的范式转换:从"人在回路中"到"人的认知在回路中"。前者要求你在场,后者要求你把自己说清楚。

*

这个视角对 HCI 意味着什么

如果接受这个框架,HCI 领域会出现几个新的设计命题:

第一,如何帮助用户"解构自己"?

当前 AI 产品的设计重心是"让用户更方便地使用 AI"。但在这个新框架下,更重要的设计问题可能是: 如何帮助用户把自己的隐性知识、判断标准、决策逻辑显性化?

大多数人从来没有被要求系统性地描述"我是怎么做决策的"。这不是写一个 prompt 就能解决的——这是一个深度的自我认知过程。什么样的工具和交互能帮助人完成这个过程?这本身就是一个 HCI 研究课题。

第二,如何设计"分身"的校准机制?

分身不可能完美。它是你某一时刻的认知快照,但你在持续进化。怎么让分身和真人保持同步?怎么检测分身的判断是否已经偏离了你当前的想法?这需要新的交互范式——不是"审批每一个输出",而是"定期校准认知模型"。

第三,如何设计人从 Loop 中"优雅抽离"的体验?

现在的 AI 系统设计,都假设人是持续在场的。但如果我们接受"人应该能抽离"这个前提,那系统需要能够:自主运转时清晰记录决策链路,在遇到超出分身能力的情况时正确中断并等待,在人回来时高效同步"你不在的时候发生了什么"。这是一整套新的交互设计问题。

*

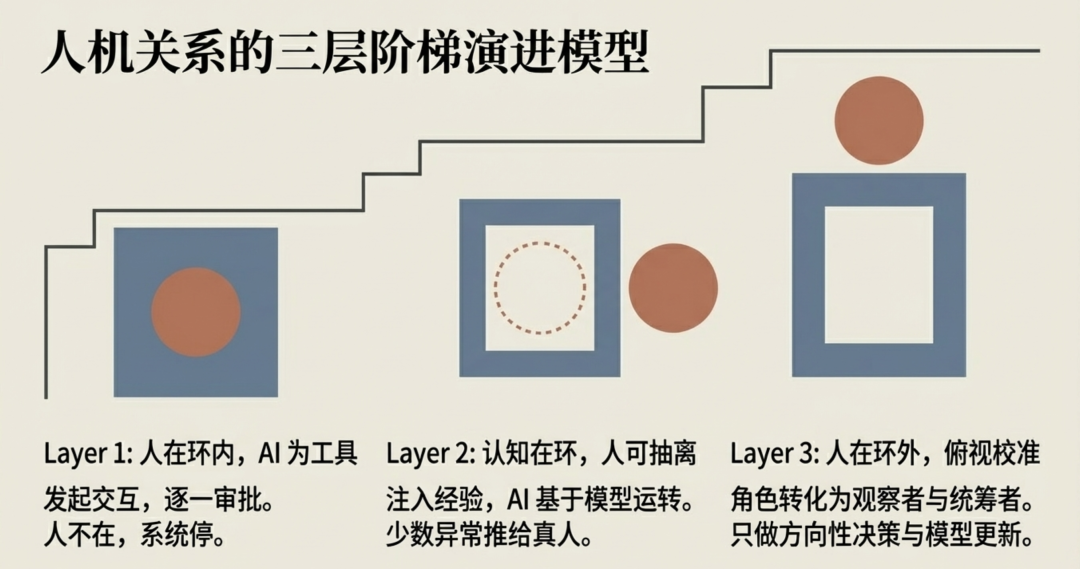

三层递进

总结一下,我把人和 AI 系统的关系分成三层:

第一层:人在 Loop 里,AI 是工具。 你发起每一次交互,审批每一个输出。你不在,系统就停。

第二层:人的认知在 Loop 里,人开始可以抽离。 你把自己的经验和标准注入系统,AI 基于你的认知模型自主运转。你只在关键时刻介入。

第三层:人在 Loop 外,观察和校准。 系统自运转,你的角色从"参与者"变成"观察者和校准者"——看系统运转得对不对,定期更新你的认知模型,在方向性问题上做决策。

大部分人还在第一层,以为自己用好了 AI。但第一层的问题是:AI 越强,你越忙。因为所有的输出都在等你。

真正用好 AI 的标志,不是你能同时指挥多少个 Agent 干活。而是你能不能从 Loop 里抽离出来——同时系统还在按你的标准运转。

*

回到"人机共生"

我一直对"人机共生"这个词有保留。因为大多数人用这个词的时候,想的还是"人和 AI 配合干活"——本质上还是人在 Loop 里。

但如果按照上面的框架,共生的真正含义可能是:

你的一部分融入了系统,系统的一部分长在了你身上。

你把认知模型注入 AI 系统,AI 系统基于你的模型持续运转,运转中产生的新洞察又反过来更新你的认知。这是一个双向的进化过程。

而这个过程有一个前提: 你愿意把更多的数据和想法给到 AI。 不是隐私意义上的"给数据",而是认知意义上的——你愿意认真地、系统地、持续地告诉 AI 你是怎么想的。

大多数人不愿意做这件事。不是因为隐私顾虑,而是因为 他们从来没有被迫把自己的思维方式说清楚过 。这很折腾,但折腾完之后,受益最大的不是 AI,是你自己。

*

我是薛志荣,3 本 AI 编程和 4 本人机交互书籍的作者,以前在华为中央研究院人机交互实验室研究汽车和机器人。

这篇文章不是一个成熟的理论,是我在构建 AgentOS 过程中产生的一些新思考。我觉得 HCI 领域需要重新审视 Human in the Loop 这个被用了太多年的概念——不是否定它,而是追问: 在 Agent 持续运转的时代,"人在回路中"这个设计假设,是否仍然成立?

或者更准确地说: 在 Loop 里的,应该是人的肉身,还是人的认知?

如果你也在思考类似的问题,欢迎交流。